概要

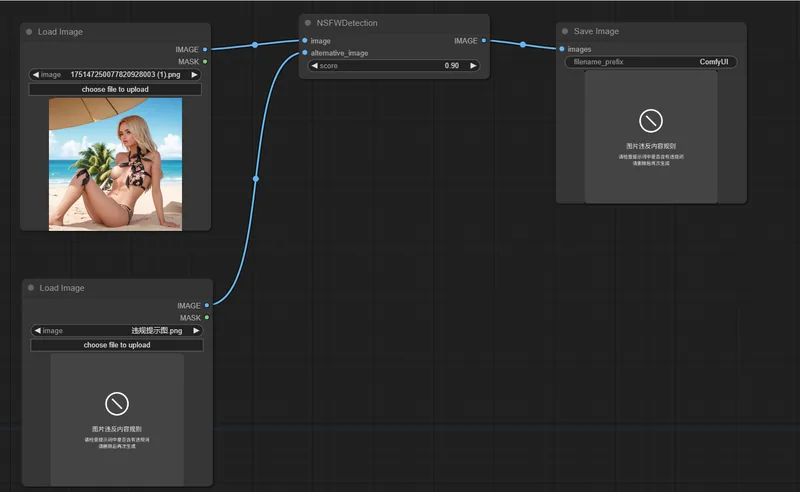

このプロジェクトは、ComfyUIで生成された画像がNSFW(Not Safe For Work)であるかどうかを検出するツールです。

機械学習モデルを用いて画像を安全か不安全かに分類し、NSFWと判断された場合は代替画像に置き換えることができます。

主な機能は`NSFWDetection`クラスの`run`メソッドに集約されており、画像、NSFWと判断する閾値、代替画像を設定して利用します。

ComfyUIで不適切なコンテンツの生成を防ぎたいクリエイターやモデレーター向けのツールです。

互換性・特徴

- ComfyUI対応

- Python

- 機械学習

- 画像処理

- カスタムノード

基本情報

| ライセンス | MIT |

| Stars | 51 |

| Forks | 18 |

| カテゴリ | ComfyUI |

| アクティビティ | low |

最新のissue

- テスト結果が非常に不正確です (更新: 2025-05-24 / The test results are very inaccurate)

- もっと情報をお願いします (更新: 2025-04-10 / More infooo please)

- issueではありませんが、追加を検討してみてはいかがでしょうか? (更新: 2025-04-10 / not an issue, but maybe something you might want to add?)

GitHub: https://github.com/trumanwong/ComfyUI-NSFW-Detection