概要

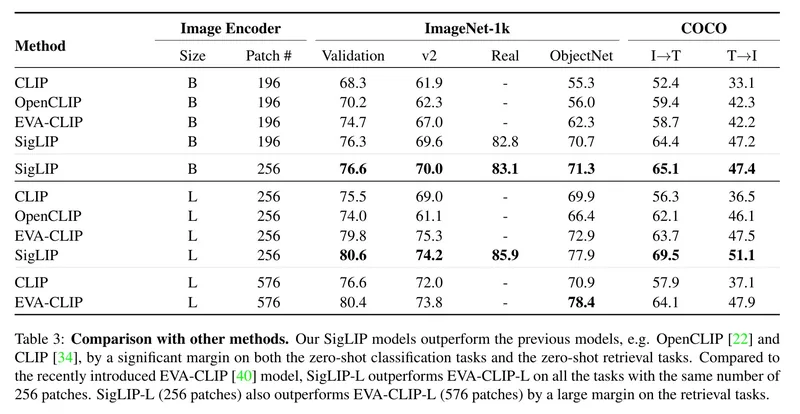

SigLIP So400m Patch14 384は、Googleの画像と言語を結び付けるマルチモーダルモデルで、ゼロショット画像分類や画像テキスト検索に使えます。

CLIP系モデルを改良したsigmoid lossを採用し、画像とテキストのペア学習に最適化されている点が特徴です。

384×384入力のshape-optimized SoViT-400m構成で、TransformersからPythonコードやpipeline APIで利用できます。

画像理解や検索機能を自作アプリに組み込みたい研究者・開発者向けです。

互換性・特徴

- Python

- Transformers

- Vision

- Zero-shot classification

- Image-text retrieval

基本情報

| ライセンス | apache-2.0 |

| Likes | 674 |

| Downloads | 2,129,671 |

| Pipeline | zero-shot-image-classification |

| カテゴリ | マルチモーダル |

| アクティビティ | mid |

HuggingFace: https://huggingface.co/google/siglip-so400m-patch14-384